Sztuczna inteligencja w przemysłowej obróbce laserowej – wizyjna kontrola jakości i autotuning parametrów

Wprowadzenie

Obróbka laserowa jest kluczową technologią w wielu gałęziach przemysłu – od motoryzacji i lotnictwa po elektronikę i inżynierię precyzyjną. Procesy takie jak spawanie laserowe, cięcie czy teksturowanie powierzchni laserem oferują wysoką precyzję i wydajność. Jednak zapewnienie stabilnej jakości tych procesów wymaga ciągłego monitorowania i optymalizacji. Tradycyjne metody kontroli jakości (np. inspekcje wizualne przez operatorów lub badania nieniszczące po fakcie) bywają czasochłonne, kosztowne i podatne na błędy ludzkie. W odpowiedzi na te wyzwania coraz częściej sięga się po sztuczną inteligencję (AI), w szczególności techniki uczenia maszynowego (ML) i głębokiego uczenia (DL), aby automatyzować kontrolę jakości oraz autonomicznie dostrajać parametry procesów laserowych w czasie rzeczywistym.

W niniejszym artykule dokonano przeglądu zastosowań AI w przemysłowej obróbce laserowej, koncentrując się na dwóch głównych obszarach: (1) wizyjna kontrola jakości procesów i produktów oraz (2) autotuning parametrów procesu. Omówione zostaną konkretne techniki ML/DL używane do detekcji defektów laserowych (np. sieci konwolucyjne CNN, segmentacja obrazu, metody nadzorowane i nienadzorowane) wraz z przykładami implementacji. Przedstawimy architektury systemów wizyjnych zintegrowanych z robotami i maszynami CNC, a następnie opiszemy podejścia oparte na AI do automatycznej optymalizacji parametrów obróbki (moc, prędkość, długość fali itp.), w tym algorytmy uczenia ze wzmocnieniem, genetyczne i logiki rozmytej. W dalszej części zaprezentowane zostaną studia przypadków z przemysłu – m.in. w spawaniu laserowym, cięciu i teksturowaniu powierzchni – wraz z osiąganymi dzięki AI rezultatami (np. poprawa wydajności, redukcja braków, lepsza jakość spoin). Na koniec zidentyfikowane zostaną główne wyzwania we wdrażaniu AI w obróbce laserowej (takie jak adaptacja do zmiennych warunków, jakość danych czy bezpieczeństwo) oraz kierunki rozwoju, w tym rola wyjaśnialnej AI (XAI), Edge AI i integracji z cyfrowymi bliźniakami procesów.

Wizyjna kontrola jakości z wykorzystaniem AI

Kontrola jakości wspomagana wizją maszynową odgrywa coraz większą rolę w procesach laserowych. Polega ona na wykorzystaniu kamer i czujników optycznych do monitorowania przebiegu procesu (np. obserwacja jeziorka spawalniczego czy strefy cięcia) oraz inspekcji gotowych spoin i wyrobów, a następnie na automatycznej analizie zebranych obrazów w celu wykrycia ewentualnych wad. Dzięki algorytmom AI systemy te mogą identyfikować defekty w czasie rzeczywistym, znacznie szybciej i dokładniej niż człowiek, co pozwala na bieżące korygowanie procesu lub odrzucanie wadliwych elementów. Poniżej opisano najważniejsze techniki uczenia maszynowego i głębokiego stosowane w wizyjnej kontroli jakości obróbki laserowej oraz architekturę takich systemów zintegrowanych z maszynami przemysłowymi.

Detekcja defektów spoin za pomocą uczenia maszynowego i głębokiego

We wczesnych zastosowaniach ML do analizy jakości spoin laserowych wykorzystywano algorytmy nadzorowane uczone na cechach ręcznie wyodrębnianych z obrazów lub sygnałów procesu. Przykładowo, analizowano sygnały z fotodiod monitorujących emisję optyczną plazmy i jeziorka spawalniczego: zaobserwowano, że zmiany intensywności emisji mogą wskazywać na powstawanie wad takich jak brak przetopu czy nadmierny przetop. Klasyczne modele ML – SVM (wektorów nośnych), kNN (k najbliższych sąsiadów) czy las losowy (Random Forest) – potrafiły na podstawie takich danych sklasyfikować stan spoiny. W badaniach Ozkat et al. wykorzystano sygnały fotodiod do detekcji trzech klas jakości spoiny laserowej: prawidłowej, z brakiem połączenia (lack of connection) oraz z nadmiernym przetopem (over-penetration). Najlepszy model SVM osiągnął ~95% dokładności na danych treningowych, a model Random Forest ~83% na danych walidacyjnych. Połączenie wielu cech sygnału pozwoliło także zidentyfikować charakterystyczne wzorce sygnałowe dla różnych typów defektów, potwierdzając użyteczność fotodiod w monitorowaniu dynamiki spawania.

Wraz z rozwojem metod głębokiego uczenia, sieci neuronowe konwolucyjne (CNN) zaczęto stosować do automatycznej analizy obrazów spoin, eliminując potrzebę ręcznego opracowywania cech. CNN potrafią same nauczyć się rozpoznawania złożonych wzorców defektów (porów, pęknięć, wtrąceń itp.) na podstawie dostatecznie dużej liczby przykładowych obrazów. Na przykład Deng i współpr. opracowali głęboką sieć CNN do rozpoznawania wad na obrazach spoin blach stalowych – wykorzystali techniki filtrowania szumów i wzmocnienia kontrastu obrazu, a następnie sieć uczoną z użyciem transfer learning. Osiągnięto imponującą skuteczność klasyfikacji wad na poziomie 98,75%, co znacząco przewyższa tradycyjne metody inspekcji i świadczy o wysokiej niezawodności tego podejścia. W innym badaniu zaproponowano model ensemble (komitetu) głębokich sieci do monitorowania spoin metodą arc welding, również uzyskując wysokie dokładności detekcji wad w czasie rzeczywistym.

Najnowsze prace korzystają z zaawansowanych architektur DL zaadaptowanych do zadań detekcji wad spoin. Przykładem może być koncepcja YOLO (You Only Look Once) – jednoukładowego detektora obiektów – dostosowana do znajdowania wad w spoinach laserowych. Ren i in. opracowali usprawnioną wersję YOLOv8 nazwaną YOLOv8-WD (Weld Defect) wyspecjalizowaną w detekcji wad spoin w złączach hamulców samochodowych. Sieć ta wykorzystuje m.in. zaawansowaną augmentację danych (obrót, odbicia, zmiany jasności), wydajną architekturę Vision Transformer (EfficientViT) jako ekstraktor cech oraz moduły łączące konwolucje z mechanizmem uwagi (CAFM – Convolution and Attention Fusion Module) i dynamiczne sploty (DyConv) zmieniające się adaptacyjnie w zależności od obrazu. Dzięki tym innowacjom model osiągnął średnią precyzję wykrywania mAP@0.5 = 90,5% na zestawach testowych, zapewniając wiarygodne zautomatyzowane rozwiązanie do inspekcji jakości spoin. Co istotne, zwiększono skuteczność wykrywania trudniejszych defektów (np. pęcherzy gazowych czy pozostałości żużla) o kilka punktów procentowych w porównaniu z bazowym modelem YOLO. Z kolei Ferguson et al. zastosowali transfer learning z dużych zbiorów obrazów do segmentacji i detekcji defektów w elementach przemysłowych, pokazując że nawet ograniczone zbiory danych z fabryk mogą zostać efektywnie wykorzystane do trenowania modeli DL dzięki uczeniu transferowemu.

Warto podkreślić, że segmentacja obrazów jest równie ważną techniką w wizyjnej kontroli jakości. Pozwala ona na pikselową lokalizację obszarów wad na zdjęciach spoin czy powierzchni ciętych elementów. Segmentacja semantyczna z użyciem sieci konwolucyjnych (np. architektury U-Net lub SegNet) umożliwia dokładne zaznaczenie np. porów czy pęknięć na obrazie spoiny, co jest przydatne przy ocenie wielkości i rozległości defektu. Baek i współpracownicy wykorzystali sieć ResNet do segmentacji jeziorka spawalniczego na obrazach z kamery – na podstawie kształtu jeziorka wyodrębnionego segmentacją, kolejna sieć (perceptron wielowarstwowy) mogła oszacować głębokość przetopu i kategoryzować stan penetracji (niedostateczna, pełna, nadmierna). Takie podejście łączące segmentację z regresją głębokości przetopu osiągnęło wysoką skuteczność przekraczającą 95% poprawnych rozpoznań stanu penetracji w badaniach laboratoryjnych.

Oprócz metod nadzorowanych, rośnie znaczenie uczenia nienadzorowanego i detekcji anomalii. W aplikacjach przemysłowych często brakuje obszernego zbioru przykładów rzadkich defektów do trenowania klasycznych modeli nadzorowanych – większość produkowanych spoin jest prawidłowa, a wadliwe pojawiają się sporadycznie. W takich sytuacjach użyteczne są algorytmy uczące się normalnego wzorca procesu i wykrywające odchylenia od tego wzorca jako potencjalne anomalie. Przykładowo, można trenować autoenkoder konwolucyjny na obrazach dobrych spoin, aby nauczył się rekonstrukcji obrazu; następnie przy kontroli nowej spoiny duży błąd rekonstrukcji sygnalizuje obecność nietypowej cechy (wady) w obrazie. Ozkat et al. zaproponowali nienadzorowaną metodę opartą na falowej transformacie rozproszenia (wavelet scattering) i jedno-wymiarowym autoenkoderze 1D-CAE do analizy sygnałów fotodiody ze spawania laserowego – sieć uczyła się wzorców sygnału dla stabilnego spawania, a odchylenia klasyfikowała jako anomalie. Uzyskano obiecujące wyniki: model nienadzorowany identyfikował anomalie z 93,3% dokładnością na danych treningowych i 87,5% na walidacyjnych, zbliżając się skutecznością do modeli nadzorowanych. Co ważne, podejście to nie wymagało ręcznego oznaczania danych, co może znacznie obniżyć koszty wdrożenia systemu kontroli jakości. Również inne prace wykazały, że klasteryzacja nienadzorowana czy detektory odchyłek (outlier detection) potrafią wykryć nietypowe zdarzenia w procesie spawania (np. nagły rozbłysk lub niestabilność jeziorka) bez wcześniejszego „widzianego” przykładu danego defektu. Trendem jest łączenie obu podejść – hybrydowe systemy używają modeli nadzorowanych tam, gdzie dostępne są dane (np. do klasyfikacji znanych rodzajów wad), a jednocześnie monitorują wskaźniki anomalii, by wykryć nowe, niespodziewane problemy jakościowe.

Podsumowując, techniki ML i DL zrewolucjonizowały wizyjną kontrolę jakości w obróbce laserowej. Dzięki nim możliwe jest automatyczne wykrywanie wad w czasie rzeczywistym na podstawie strumienia danych z kamer i czujników, z dokładnością sięgającą 90–99% w warunkach testowych. Uczenie głębokie eliminuje żmudne programowanie reguł i ekstrakcji cech – system uczy się bezpośrednio na obrazach/sygnałach. To przekłada się na zwiększenie skuteczności i szybkości kontroli oraz redukcję odpadów produkcyjnych poprzez wczesne wykrycie wad i możliwość natychmiastowej interwencji. Poniżej omówiono, jak takie inteligentne systemy wizyjne są integrowane z infrastrukturą przemysłową (robotami i maszynami CNC), aby działały niezawodnie w warunkach produkcyjnych.

Architektura systemów wizyjnych i integracja z robotyką i CNC

Systemy wizyjne do kontroli procesu laserowego składają się zazwyczaj z kamery lub zespołu kamer (np. kamera wizyjna rejestrująca obraz spoiny z boku oraz kamera termowizyjna rejestrująca rozkład temperatur), oświetlenia zapewniającego powtarzalne warunki obrazowania, sprzętu akwizycji i przetwarzania danych (komputer przemysłowy, często z akceleratorem GPU) oraz oprogramowania AI wykonującego analizę obrazu. Ważnym elementem jest sposób mocowania i kalibracji kamery względem obiektu i narzędzia laserowego. Stosuje się konfiguracje stacjonarne (kamera obserwuje proces z ustalonej pozycji, np. z boku stanowiska) albo mobilne montowane na robotach (kamera porusza się wraz z głowicą laserową – tzw. układ eye-in-hand w robotyce).

Integracja z robotami spawalniczymi i obrabiarkami CNC pozwala wykorzystać informacje wizyjne do automatycznego sterowania i korekcji trajektorii lub parametrów procesu. Przykładowo, w zrobotyzowanym spawaniu laserowym często występuje problem precyzyjnego trafienia wiązką laserową w szczelinę spoiny, zwłaszcza przy częściach o nieidealnym dopasowaniu lub położeniu. W tradycyjnym podejściu programuje się trajektorię robota na oko lub korzystając z przybliżonych modeli, co może zawieść, gdy element jest minimalnie przesunięty. Rozwiązaniem jest aktywne śledzenie spoiny (weld seam tracking) za pomocą czujników wizyjnych. Typowy przemysłowy system tego rodzaju wykorzystuje lasery profilujące rzucające linię lub wzór na złącze spawane oraz kamerę odbierającą obraz tego wzoru – odkształcenie linii laserowej wskazuje położenie i kształt szczeliny spawalniczej. Układ sterowania robota na bieżąco koryguje pozycję narzędzia, utrzymując je w osi spoiny z dokładnością rzędu dziesiątych części milimetra.

W literaturze naukowej pojawiają się coraz doskonalsze rozwiązania, integrujące detekcję wizualną opartą na AI z ruchem robota. Li i in. (2023) zaproponowali system, w którym kamera głębi Intel RealSense zamontowana na robotzie najpierw wykonuje globalne rozpoznanie położenia spoiny za pomocą algorytmu YOLOv5 z mechanizmem uwagi, a następnie robot zbliża się do detalu i dalsze precyzyjne prowadzenie spawania przejmuje czujnik laserowy zamontowany przy palniku. Dzięki połączeniu szerokiego pola widzenia kamery głębi (pozwalającej wykryć spoinę z większej odległości, nawet gdy położenie elementu jest nieznacznie przesunięte) z wysoką dokładnością lokalną czujnika wizyjnego laserowego (LVS), uzyskano w pełni zautomatyzowane odnajdywanie i spawanie złącza bez ingerencji operatora. W testach tego systemu błąd prowadzenia spoiny wyniósł maksymalnie 2,9 mm przy dystansie kamery 0,3 m od obiektu, a względny błąd poniżej 2% dla odległości 0,3–2 m. Oznacza to, że nawet przy dużych odchyłkach położenia spoin system potrafi poprawnie nakierować robota – po zgrubnym zlokalizowaniu ścieżki spoiny, czujnik prowadzenia (LVS) dokładnie utrzymuje palnik w centrum szczeliny, osiągając ostatecznie precyzję rzędu 1–3 mm, w pełni akceptowalną w praktyce. Co istotne, zastosowanie lekkiego modelu YOLOv5s z mechanizmem Coordinate Attention (CA) sprawiło, że całość działa w czasie rzeczywistym (ok. 20 klatek na sekundę), a model detekcji jest na tyle mały (17 MB), że może być zaimplementowany na wbudowanym kontrolerze robota. Jest to przykład Edge AI – wykonywania obliczeń AI bezpośrednio na urządzeniu brzegowym (w tym wypadku w kontrolerze robota) – co eliminuje opóźnienia i zależność od połączenia z chmurą.

Integracja systemów wizyjnych z maszynami CNC do cięcia laserowego również przynosi duże korzyści. Kamery mogą monitorować jakość krawędzi cięcia (np. wykrywać zadymienie, nadtopienia, pozostałości żużla) i w razie wykrycia odchyłek od normy – sygnalizować maszynie konieczność zmiany parametrów (zwolnienie posuwu, zmiana mocy lub gazu asystującego) albo oznaczać dany wyrób do ponownej obróbki. W aplikacjach cięcia konturów z blach stosuje się systemy wizyjne do korekcji położenia – przed rozpoczęciem cięcia kamera skanuje położenie rzeczywistego arkusza na stole i koryguje program CNC tak, aby wzór wycięcia był idealnie wpasowany (kompensując np. obrócenie lub przesunięcie arkusza). W ten sposób unika się błędów i redukuje odpad materiału. Innym zastosowaniem jest wizyjna inspekcja wyciętych elementów na przenośniku – sieci DL mogą w locie sprawdzać, czy kontur jest w pełni wycięty, czy nie ma pozostałych mikrołączników, czy nie występują deformacje krawędzi; wadliwe sztuki mogą być automatycznie odrzucone lub skierowane do poprawki.

Nieodzownym aspektem architektury takich systemów jest synchronizacja i integracja danych z wielu źródeł. Często łączy się dane wizyjne z innymi czujnikami (multimodalnie) – np. sygnał akustyczny (dźwięk plazmy podczas spawania), wibracje, pomiary prądu i napięcia lasera – by zwiększyć pewność detekcji wad. Przykładowo, Deng et al. zbudowali system fuzji danych z wielu czujników do monitorowania spawania laserowego: łącząc sygnały optyczne z fotodiod, emisji akustycznej i pomiary procesu, i wykorzystując algorytm lasu losowego do klasyfikacji stanów spoiny. Wykazano, że model uczony na danych połączonych przewyższa dokładnością modele oparte na pojedynczych sensorach, dzięki możliwości uchwycenia bardziej złożonych zależności i kompensacji zakłóceń na jednym kanale informacją z innego.

W praktyce przemysłowej systemy wizyjne z AI integruje się poprzez sterowniki PLC lub komputery przemysłowe komunikujące się z maszyną/robotem. Po wykryciu defektu system może np. zatrzymać proces, wygenerować alarm dla operatora lub nawet automatycznie skorygować parametry (jeśli zdefiniowano taką logikę sterowania). Nowoczesne linie produkcyjne dążą do pełnej autonomii: kamery śledzą 100% produkcji w czasie rzeczywistym, a decyzje podejmowane są automatycznie. Dzięki Edge AI i wydajnym algorytmom, już dziś możliwa jest inspekcja każdej spoiny w locie bez spowalniania produkcji – system jest w stanie analizować obraz spoiny w trakcie spawania i natychmiast wskazać nieprawidłowość. Przykładową platformę sprzętową takiego systemu pokazano na rysunku poniżej.

Rys. 1. Przykładowe stanowisko wizyjnej kontroli jakości spoiny laserowej. Kamera przemysłowa z oświetleniem pierścieniowym rejestruje obraz spoiny (widoczny na monitorze), a następnie algorytmy głębokiego uczenia analizują obraz w celu wykrycia ewentualnych defektów.

Podsumowując, połączenie technik wizyjnych z AI oraz integracja tych systemów z robotami i CNC umożliwia bieżący nadzór nad procesem laserowym i aktywną kontrolę jakości. Systemy te odciążają człowieka w żmudnych zadaniach inspekcji, reagują szybciej niż ludzkie oko i mogą działać w trudnych warunkach (wysoka jasność łuku, ultrafiolet od plazmy itp.) poprzez odpowiedni dobór sensorów i filtrów. Automatyzacja kontroli jakości przekłada się na większą powtarzalność i wydajność produkcji oraz mniej braków i poprawek, co ma wymierne skutki ekonomiczne.

Autotuning parametrów procesu laserowego za pomocą AI

Oprócz pasywnej kontroli jakości (wykrywania wad), sztuczna inteligencja umożliwia również aktywne sterowanie procesem – czyli autotuning parametrów obróbki laserowej w celu optymalizacji wyników. W tradycyjnym podejściu parametry takie jak moc lasera, prędkość posuwu, częstość impulsów czy pozycja ogniska są ustalane na podstawie doświadczenia inżynierów procesowych lub poprzez eksperymentalne doświadczalne dostrajanie (metodą prób i błędów). Jest to czasochłonne i nie gwarantuje optymalnych rezultatów w zmiennych warunkach. AI oferuje możliwości automatycznego dostosowania parametrów w odpowiedzi na bieżące warunki procesu oraz uczenia się na podstawie zebranych danych, aby poprawiać efektywność i jakość procesu bez ciągłej ingerencji człowieka.

W tej części omówimy kluczowe techniki AI wykorzystywane do autotuningu: uczenie ze wzmocnieniem (reinforcement learning, RL), algorytmy optymalizacji oparte na metaheurystykach (np. algorytmy genetyczne) oraz podejścia wykorzystujące logikę rozmytą i systemy eksperckie. Następnie zaprezentujemy przykłady zastosowania autotuningu AI w spawaniu, cięciu i teksturowaniu laserowym, wraz z osiągniętymi usprawnieniami procesu.

Techniki AI do automatycznej optymalizacji parametrów

Uczenie ze wzmocnieniem (RL) jest obiecującym paradygmatem, w którym agent (np. algorytm sterujący laserem) uczy się poprzez interakcję z otoczeniem, jakie działania (ustawienia parametrów) przynoszą najlepsze nagrody z punktu widzenia celu (np. jakość spoiny, szybkość procesu, minimalizacja defektów). W kontekście procesów laserowych agent RL może np. co kilka milisekund zmieniać moc lasera lub prędkość posuwu i na podstawie czujników oceniać efekt (nagrodą może być np. stabilność jeziorka, brak odprysków, odpowiednia głębokość przetopu). Podejście RL jest szczególnie atrakcyjne, gdy proces jest zbyt złożony, by precyzyjnie go modelować, lub warunki dynamicznie się zmieniają.

W literaturze opisano już zastosowania RL do spawania laserowego. Przykładowo, Günther et al. (2016) zaproponowali architekturę sterowania spawaniem wykorzystującą sieć neuronową głęboką do predykcji jakości i algorytm ze wzmocnieniem do uczenia się kontroli mocy lasera w oparciu o te predykcje. Masinelli i in. (2020) wykorzystali RL (algorytm Deep Q-Network) do adaptacyjnej kontroli procesu spawania laserowego, demonstrując poprawę stabilności przetopu i jakości spoiny. Natomiast najnowsze badania skupiają się na implementacji RL w systemach wbudowanych o niskich opóźnieniach. Shevchik i współaut. (2023) pokazali, że agent RL zaimplementowany na programowalnej platformie FPGA potrafi sterować mocą lasera w czasie rzeczywistym z częstotliwością próbkowania 100 kHz, reagując natychmiast na zmiany w procesie. Rozwiązanie to, oparte o algorytm Soft Actor-Critic (SAC) działający na układzie FPGA, umożliwia wysyłanie komend sterujących do lasera szybciej niż nadejdzie kolejna próbka sygnału sensorycznego – praktycznie bez opóźnień, co jest kluczowe przy dynamicznych zjawiskach w jeziorku spawalniczym. System ten potrafił samodzielnie nauczyć się strategii regulacji mocy w zależności od warunków powierzchni materiału (np. inna chropowatość) tak, by utrzymać stabilny przetop. W testach laboratoryjnych adaptacyjny RL przewyższył klasyczną strategię stałej mocy lasera – na powierzchniach piaskowanych osiągnął do 22,6% wyższą wartość funkcji nagrody powiązanej z jakością spoiny w porównaniu do najlepszego stałego ustawienia mocy, a na powierzchniach mieszanych o ~7,3%. Analiza przekrojów spoin wykazała, że polityka sterowania wyuczona przez RL zapewniała większe i głębsze jeziorka przetopu niż tradycyjna strategia, co wskazuje na poprawę penetracji i ogólnej jakości spoiny. Jest to wymierny dowód, że RL może automatycznie dostroić parametry tak, aby kompensować zmienność warunków (np. różna szorstkość czy przygotowanie powierzchni) lepiej niż statycznie zaprogramowane ustawienia.

Innym podejściem do autotuningu są algorytmy genetyczne (GA) i ogólnie metaheurystyki optymalizacyjne (np. algorytm rojowy PSO, symulowane wyżarzanie). Mogą one służyć do offline’owego doboru optymalnych parametrów lub nawet online, jeśli czas oceny jest krótki. Algorytm genetyczny imituje proces ewolucji – utrzymuje populację potencjalnych rozwiązań (wektorów parametrów procesu) i poprzez selekcję, krzyżowanie i mutacje stara się z pokolenia na pokolenie poprawiać wyniki (np. jakość spoiny mierzona pewną funkcją celu). W zastosowaniu do obróbki laserowej często GA łączy się z modelami predykcyjnymi: najpierw trenowany jest model (np. sieć neuronowa) przewidujący wynik procesu na podstawie parametrów, a następnie GA przeszukuje przestrzeń parametrów używając tego modelu jako szybką „funkcję fitness”. Tak zrobili np. Baluye et al., którzy zastosowali hybrydę ANN-GA do optymalizacji spawania laserowego stali nierdzewnej – sieć neuronowa uczyła się odwzorowania między parametrami (moc, prędkość, odstęp dyszy) a szerokością strefy wpływu ciepła (HAZ) i wytrzymałością spoiny, a następnie algorytm genetyczny znajdował kombinację minimalizującą szerokość HAZ przy jednoczesnym spełnieniu kryteriów wytrzymałościowych. W podobny sposób wielokryterialne GA stosowano do znalezienia kompromisu między jakością spoiny a wydajnością procesu – np. minimalizacja porowatości i defektów przy maksymalnej szybkości spawania. Choć GA wymaga wielu iteracji, może działać w tle lub w symulacji; przy wsparciu mocy obliczeniowej współczesnych komputerów możliwe jest przetestowanie setek czy tysięcy kombinacji parametrów w krótkim czasie, co dawniej wymagałoby wielu dni eksperymentów.

Kolejną rodziną technik są systemy rozmyte i neuro-rozmyte. Logika rozmyta (fuzzy logic) była jedną z pierwszych metod AI stosowanych w adaptacyjnym sterowaniu spawaniem już w latach 90. Systemy rozmyte bazują na wiedzy eksperckiej zakodowanej w postaci reguł typu IF-THEN z użyciem lingwistycznych zmiennych rozmytych (np. „jeśli jasność jeziorka jest niska i spadek napięcia wysoki, to zwiększ moc lasera nieznacznie”). Fuzzy logic dobrze radzi sobie z niepewnością i brakiem precyzyjnego modelu matematycznego – zamiast tego opiera się na intuicji doświadczonych operatorów. Przykładowo, zbudowano rozmyte regulatory utrzymujące stałą szerokość jeziorka spawalniczego CO₂ przez ciągłe korygowanie prędkości spawania na podstawie analizy wizyjnej topienia – kamera wideo obserwowała kształt jeziorka, a system sterowania rozmytego dostosowywał parametry, by zachować prawidłową geometrię spoiny. Podobny system ekspercki oparty na fuzzy logic do spawania blach cienkich CO₂ regulował moc i szybkość w zależności od obserwowanej penetracji, osiągając stabilniejszy proces niż sterowanie stałe.

Minusem czystego podejścia rozmytego jest konieczność zaprogramowania (ustalenia) reguł i funkcji przynależności przez eksperta – co bywa trudne i może nie nadążać za dynamicznymi, szybkozmiennymi warunkami (np. gwałtowne zakłócenie). Dlatego rozwinięto adaptacyjne systemy neuro-rozmyte (ANFIS), które łączą zalety sieci neuronowych (uczenie się z danych) z interpretowalnością systemów rozmytych. ANFIS może samoczynnie dostrajać parametry funkcji przynależności i reguł rozmytych na podstawie danych wejściowo-wyjściowych z procesu, dzięki czemu unika się polegania wyłącznie na wiedzy eksperta. W najnowszej pracy (Xiang et al. 2025) zaproponowano metodę sterowania penetracją spoiny przy spawaniu łukowym GMAW wykorzystującą algorytm Neighborhood Rough Set – ANFIS (NRS-ANFIS). Najpierw zastosowano teorię zbiorów przybliżonych (rough sets) do automatycznej selekcji najistotniejszych cech obrazu jeziorka (np. szerokość i pole ogona jeziorka) oraz cech procesu (zmiana szczeliny, prąd) wpływających na przetop. Następnie te cechy podano do systemu ANFIS, który uczył się reguł regulacji parametrów spawania (prądu i prędkości podawania drutu) w celu utrzymania pełnego przetopu mimo zmiennej szczeliny między elementami. Wyniki eksperymentalne dla próbki z cyklicznie zmieniającą się szczeliną wykazały, że przy braku preheatingu model ANFIS uzyskał 87% skuteczności pełnego przetopu (spoiny z pełnym przetopem na wylot) oraz równomierną szerokość ściegu od spodu, spełniając wymagania jakościowe norm spawalniczych. To znacząca poprawa względem zwykłego spawania ze stałymi parametrami, gdzie przy zmiennej szczelinie wiele odcinków spoiny byłoby nie w pełni przetopionych lub nadmiernie wtopionych. System neuro-rozmyty adaptacyjnie zwiększał prąd w miejscach większej szczeliny i zmniejszał przy mniejszej, naśladując doświadczonego spawacza, ale z szybkością i precyzją niedostępną dla człowieka.

Podobne idee zastosować można do procesów cięcia laserowego – np. fuzzy logic może dynamicznie dostosowywać moc lasera i ciśnienie gazu w zależności od obserwowanej jakości krawędzi (iskrzenia, dymienia), aby zapobiec powstawaniu zadziorów. Algorytmy genetyczne są wykorzystywane do doboru parametrów impulsowego teksturowania laserowego (gdzie jednocześnie trzeba dobrać gęstość energii, częstotliwość impulsów i prędkość skanowania dla uzyskania pożądanego wzoru powierzchni). Uczenie ze wzmocnieniem można by zastosować np. do sterowania trajektorią lasera w procesach mikroobróbki, gdzie laser „uczy się” jak prowadzić wiązkę, by uzyskać założony wzór (choć tu częściej stosuje się optymalizację kształtu impulsu). W kolejnej sekcji przedstawiamy konkretne przykłady wdrożeń autotuningu AI w przemyśle.

Przykłady zastosowań autotuningu – spawanie, cięcie, teksturowanie

Spawanie laserowe: Dzięki AI możliwe jest tworzenie inteligentnych systemów spawarek laserowych, które same dobierają parametry spawania w czasie rzeczywistym w zależności od warunków. Przykładowo, w przemyśle motoryzacyjnym testuje się spawarki laserowe wyposażone w czujniki monitorujące na bieżąco wielkość jeziorka i wysokość podtopienia spoiny – jeśli system wykryje, że spoina staje się wklęsła (ryzyko braku przetopu), automatycznie zwiększa moc lub zmniejsza prędkość; jeśli pojawia się nadmierne wypływanie materiału (wypukła spoina, ryzyko nadtopienia), parametry są korygowane w drugą stronę. Taki zamknięty układ sterowania sprzężeniem zwrotnym redukuje liczbę braków i potrzebę późniejszego naprawiania spoin – jakość jest zapewniana in-situ. Wspomniany wcześniej przykład RL na FPGA można traktować jako studium przypadku – system RL + czujniki optyczne w czasie rzeczywistym utrzymywał jakość spoiny stalowej 316L mimo zmiennej chropowatości powierzchni (imitującej np. zmienną czystość lub przygotowanie elementów) i osiągnął wyższą stabilność procesu niż tradycyjna metoda ustawień stałych. Również w branży lotniczej prowadzi się prace nad adaptacyjnym spawaniem elementów silników odrzutowych – warunki termiczne potrafią tam się zmieniać w trakcie wykonania długiej spoiny, więc spawarka z AI modyfikuje parametry, by utrzymać geometrię spoiny w wymaganych tolerancjach. Rezultaty wdrożeń AI w spawaniu laserowym to m.in. wyższa wytrzymałość i powtarzalność spoin, mniej przerwanych spawów (bo system koryguje zanim dojdzie do przerwania ciągłości spoiny), a także krótsze czasy przygotowania produkcji – zamiast długo dostrajać parametry na etapie prototypu, inteligentna spawarka sama znajduje ustawienia optymalne do nowych materiałów czy grubości.

Cięcie laserowe: W przypadku cięcia istotne jest uzyskanie czystej, równej krawędzi bez zwęglenia i zadziorów, przy możliwie najwyższej prędkości cięcia (co daje wydajność). AI może pomóc w automatycznej optymalizacji parametrów cięcia dla różnych materiałów i grubości. Przykładowo, dla nowego typu stopu albo kompozytu, zamiast manualnie testować dziesiątki kombinacji mocy i prędkości, model uczący się (np. regresyjna sieć neuronowa) może zostać wytrenowany na bazie kilku prób, a następnie algorytm optymalizacyjny (np. genetyczny) wyszukać zestaw ustawień dający gładką krawędź i minimalny HAZ. W literaturze opisywano zastosowania GA do optymalizacji jednocześnie trzech parametrów cięcia (moc, prędkość, ciśnienie gazu) w celu zminimalizowania chropowatości krawędzi i szerokości szczeliny cięcia – wyniki wskazują, że algorytm potrafił znaleźć ustawienia lepsze niż punkt odniesienia doświadczalnego, poprawiając chropowatość o kilkanaście procent. W trybie online, inteligentny kontroler może reagować na sygnały np. z fotodiody monitorującej plazmę cięcia: gdy wykryje wzrost emisji świadczący o niedocięciu materiału (plazma „ciągnie” się za wiązką), może spowolnić posuw albo dodać mocy, by zapewnić pełne przecięcie. To zapobiega sytuacji, że po procesie okazuje się, iż elementy nie zostały do końca wycięte i trzeba je docinać lub złomować – AI redukuje odpady i przestoje. Firmy zajmujące się wycinarkami laserowymi sygnalizują, że w najbliższych latach cyfrowe bliźniaki i AI będą standardem przy optymalizacji parametrów – symulując proces cięcia wirtualnie i wykorzystując ML do predykcji wyniku, będzie można unikać metod prób i błędów na fizycznych maszynach.

Teksturowanie laserowe: Teksturowanie powierzchni (np. laserowe trawienie mikro-wzorów dla poprawy własności tribologicznych lub estetycznych) to proces, w którym AI także znalazła zastosowanie, głównie na etapie przewidywania efektów i doboru parametrów. W odróżnieniu od spawania czy cięcia, teksturowanie często polega na wyzwalaniu bardzo krótkich impulsów (nanosekundowych, pikosekundowych, a nawet femtosekundowych) w siatce punktów tworzących określony wzór (np. rowki, dołki). Parametry takie jak energia impulsu, częstotliwość, prędkość skanera i liczba przejść determinują uzyskany kształt struktur (głębokość, szorstkość powierzchni). Zamiast ręcznie dobierać parametry, modele ML mogą nauczyć się związku pomiędzy parametrami a cechami otrzymanej faktury. Przykładowo, Seid Ahmed i in. (2024) zastosowali drzewa decyzyjne, SVM i sieć neuronową do przewidywania głębokości oraz jakości tekstury uzyskiwanej femtosekundowym laserem na węgliku spiekanym. Ich najlepszy model (sieć ANN) potrafił z dużą dokładnością przewidzieć głębokość wytworzonych mikro-rowków na podstawie ustawień lasera, co pozwoliło zrealizować odwrotny cel: zadawszy pożądaną głębokość i charakter tekstury, algorytm optymalizacyjny znalazł parametry lasera osiągające ten cel. Tym samym wyeliminowano znaczną część eksperymentalnego strojenia – oszczędzając czas i materiał, a także uzyskując lepsze rezultaty, niż bazując tylko na intuicji. Innym przykładem jest użycie algorytmów genetycznych do optymalizacji wzorca interferencyjnego przy laserowym teksturowaniu powierzchni – algorytm poszukiwał najlepszej kombinacji przekrywania wiązek laserowych, by uzyskać określoną topografię o minimalnej chropowatości. W branży obróbki precyzyjnej, gdzie laser używany jest do nadawania właściwości hydrofobowych lub adhezyjnych poprzez mikrostruktury, AI pomaga osiągnąć docelowe parametry (np. kąt zwilżania) poprzez sterowanie teksturą. Sumarycznie, w teksturowaniu AI przyspiesza rozwój nowych procesów, umożliwiając szybkie przeszukanie dużej przestrzeni parametrów i przewidzenie efektów – co jest bardzo cenne, biorąc pod uwagę, że testy doświadczalne mikrostruktur pod mikroskopem elektronowym są czasochłonne.

Studium przypadków: W zakładach przemysłowych wdrażających AI obserwuje się wymierne korzyści. Przykładowo, linia spawania karoserii samochodowych wyposażona w system wizyjny z CNN do inspekcji jakości zgrzewów i spoin laserowych zredukowała udział braków o 30%, ponieważ wadliwe spoiny były wykrywane natychmiast i robot spawalniczy mógł wykonać dodatkowe pokrycie wadliwej spoiny lub oznaczyć część do naprawy przed kolejnymi operacjami (unikając kosztownego demontażu produktu po finalnym montażu). W fabryce produkującej baterie litowe, gdzie używane jest cięcie laserowe folii, zastosowanie modelu ML do kontroli mocy lasera względem prędkości przesuwu folii zapewniło jednorodność nacięć i wyeliminowało mikropęknięcia folii, co wcześniej zdarzało się przy ręcznym nastawianiu i powodowało awarie baterii. W firmie narzędziowej zastosowanie cyfrowego bliźniaka procesu hartowania laserowego (laser hardening) połączonego z algorytmem RL pozwoliło w symulacji wypracować strategię skanowania wiązką, która redukuje odkształcenia hartowanego elementu o 50% – tak wytrenowany model zaimplementowano potem na rzeczywistej maszynie, skracając czas dochodzenia do idealnych ustawień z tygodni do dni.

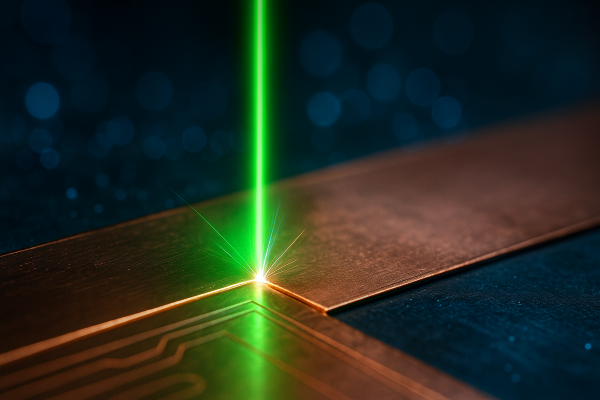

Powyższe przykłady ilustrują potencjał AI w podnoszeniu jakości i wydajności procesów laserowych. Poniższy rysunek przedstawia fragment zautomatyzowanego stanowiska spawania laserowego: widoczna jest głowica spawająca robota oraz czujnik laserowy (czerwone linie laserowe) do wizyjnego wykrywania szczeliny spoiny – takie układy umożliwiają robotom samodzielne znajdowanie linii spoiny i dynamiczne korygowanie toru spawania.

Rys. 2. Zrobotyzowane stanowisko spawania laserowego z czujnikiem wizyjnym do śledzenia spoiny. Czerwony krzyż laserowy rzutowany na materiał pozwala systemowi zlokalizować pozycję szczeliny spawalniczej, a następnie robot precyzyjnie prowadzi głowicę (palnik) wzdłuż wyznaczonej ścieżki. Takie sprzężenie wizyjne zwiększa autonomię systemu i eliminuje potrzebę ręcznego naprowadzania czujników.

Główne wyzwania i kierunki rozwoju

Wdrożenie sztucznej inteligencji w przemysłowej obróbce laserowej niesie ze sobą nie tylko korzyści, ale również wyzwania. Poniżej omawiamy najważniejsze z nich oraz trendy i kierunki badań, które mają te wyzwania adresować, czyniąc systemy AI bardziej skutecznymi, zaufanymi i szeroko stosowalnymi w warunkach przemysłowych.

Adaptacja do zmiennych warunków: Procesy laserowe zachodzą często w zmiennym otoczeniu – mogą wystąpić wahania właściwości materiału (np. inna partia stali o nieco innym składzie), zmiany w ustawieniu optyki, zabrudzenia soczewek, drgania maszyny czy wahania temperatury otoczenia. Modele AI wytrenowane w określonych warunkach mogą tracić dokładność, gdy warunki się zmienią (problem robustości i generalizacji). Wyzwanie to dotyczy np. sieci detekcji wad – model wyuczony na obrazach z idealnej kamery może sobie nie radzić, gdy oświetlenie się pogorszy albo kamera lekko rozogniskuje. Dlatego kluczowym kierunkiem rozwoju jest tworzenie modeli odpornych na zmienność (poprzez augmentację danych treningowych, trenowanie na danych z różnych warunków) oraz zdolnych do uczenia się adaptacyjnego online. Przykładem jest zastosowanie uczenia transferowego – model DL może być wstępnie wytrenowany na dużym zbiorze ogólnym (by nauczyć się podstawowych cech), a następnie dopasowany (fine-tuned) na mniejszej próbce z konkretnej linii produkcyjnej. Innym podejściem jest uczenie przez wzmacnianie adaptacyjne, gdzie agent RL potrafi rozpoznać, że charakterystyki procesu się zmieniły, i dostosować strategię sterowania (np. RL wykrywający drastyczną zmianę sygnału i przechodzący w tryb ponownego eksplorowania optymalnych akcji). Dużo uwagi poświęca się też metodom uczenia bez nadzoru do wykrywania tzw. driftu danych – system monitoruje strumień danych z procesu i sygnalizuje, gdy statystyki istotnie odbiegają od warunków, na jakich uczony był model, co może inicjować ponowne dostrajanie modelu.

Jakość i dostępność danych: Algorytmy AI, zwłaszcza deep learning, zwykle wymagają dużych zbiorów danych treningowych, reprezentatywnych dla różnorodności przypadków (w tym defektów). W realiach przemysłowych zebranie obszernego zbioru obrazów wadliwych spoin czy nieudanych cięć jest trudne, bo proces jest zwykle optymalizowany tak, by wad było mało. To powoduje problem niezbilansowanych danych (przewaga przykładów pozytywnych – dobrych spoin). Wyzwanie to jest adresowane przez: (a) generowanie syntetycznych danych – np. symulacje numeryczne procesów (metodą elementów skończonych czy ray-tracingu) mogą tworzyć wirtualne obrazy spoin z defektami do trenowania AI; (b) augmentacja danych – generowanie wariantów istniejących obrazów przez przekształcenia (obrót, szum, zmiana kontrastu), co efektywnie powiększa zbiór treningowy; (c) uczenie pół-nadzorowane lub nienadzorowane, które potrafi wykorzystać również dane nieoznaczone. Coraz częściej stosuje się też podejście transfer learning z pokrewnych dziedzin – np. sieć nauczona rozpoznawać defekty spawalnicze może posłużyć jako punkt startowy do uczenia sieci wykrywającej defekty cięcia, co zmniejsza wymagania co do danych. Wreszcie, pewną rolę odgrywa ekspertyza ludzka w pętli (human-in-the-loop) – system może uczyć się online, prosząc sporadycznie eksperta o weryfikację, czy dany wykryty „dziwny” przypadek to nowy defekt czy fałszywy alarm, co wprowadza dodatkowe etykiety do zbioru.

Niezawodność i bezpieczeństwo AI: W kontekście przemysłowym bezpieczeństwo ma dwojakie znaczenie – chodzi zarówno o bezpieczeństwo ludzi i sprzętu (system AI nie może spowodować niebezpiecznej sytuacji, np. błędnie sterując laserem, co mogłoby uszkodzić maszynę lub produkt), jak i o zaufanie do decyzji AI w krytycznych zastosowaniach (np. w lotnictwie każda spoina musi być pewna). Obecnie systemy AI przechodzą rygorystyczne testy zanim zostaną dopuszczone do autonomicznego działania – często nadal utrzymuje się nadzór człowieka. Przykładowo, jeśli system wizyjny wykryje wadę krytyczną spoiny w konstrukcji nośnej, może oznaczyć ją do inspekcji przez kontrolera NDT zamiast samodzielnie wycofać wyrób. Nad poprawą bezpieczeństwa pracuje się poprzez implementację mechanizmów fail-safe – np. agent RL może mieć ograniczenia na akcje (nie wyjdzie poza zakresy mocy bezpieczne dla materiału), a system wizyjny może sygnalizować brak pewności (np. niska pewność detekcji → wyślij do dodatkowej kontroli zamiast podejmować automatyczną decyzję). Istotne jest również cyberbezpieczeństwo – w dobie Przemysłu 4.0 systemy laserowe z AI są często połączone sieciowo; należy zabezpieczyć je przed manipulacją (np. ktoś mógłby wpłynąć na czujniki, co mogłoby zmylić AI i spowodować wadliwą produkcję). Regulacje i normy dotyczące tzw. safety of AI w przemyśle dopiero się kształtują.

Wyjaśnialność (Explainable AI): Aby zwiększyć zaufanie do AI, dąży się do tego, by decyzje algorytmów były interpretowalne dla inżynierów. W klasycznych systemach ekspert rozumiał, że np. „jeśli amplituda drgań > X to znaczy, że jest defekt Y”. W sieciach neuronowych decyzja zapada wewnątrz „czarnej skrzynki”. Dlatego rozwijane są metody XAI dla przemysłu – np. wizualizacje Grad-CAM pokazujące na obrazie spoiny, na które obszary model patrzył, podejmując decyzję o odrzuceniu jakości. Jeśli model zaznacza na czerwono pewne okolice, inżynier może sprawdzić, czy faktycznie jest tam defekt (np. por) – to pomaga zarówno wyłapać ewentualne błędne decyzje modelu (np. model myli refleks światła z defektem), jak i ulepszyć model (poprzez np. dodanie takich przypadków do treningu). Inny przykład XAI to ekstrahowanie reguł z modelu: z trenowanej sieci można starać się wydobyć w postaci logicznej zależności, np. „jeśli nastąpił spadek intensywności plazmy o >20% i jednocześnie wzrosła emisja akustyczna, to model uznaje, że jest brak przetopu”. Takie reguły mogą zostać zweryfikowane przez ekspertów domenowych i w razie czego model może być dostrojony, by bardziej odpowiadał wiedzy inżynierskiej. Dzięki XAI zwiększa się akceptacja AI w fabryce – pracownicy, widząc uzasadnienie decyzji, chętniej ufają systemowi i są w stanie lepiej z nim współpracować.

Edge AI i obliczenia w czasie rzeczywistym: Wyzwanie stanowi również implementacja wydajnościowa – wiele algorytmów AI wymaga sporych mocy obliczeniowych, tymczasem w przemyśle preferuje się przetwarzanie lokalne (na linii produkcyjnej) z minimalnymi opóźnieniami. Przesyłanie strumieni wideo HD z procesu do chmury w celu analizy byłoby kłopotliwe (opóźnienia, ryzyko awarii sieci, kwestie poufności danych produkcyjnych). Dlatego rozwija się Edge AI, czyli umieszczanie akceleratorów AI bezpośrednio na hali produkcyjnej – czy to w postaci wbudowanych GPU, czy układów FPGA lub ASIC zdolnych do szybkiego wykonywania sieci neuronowych. Przykład omówionego systemu RL na FPGA pokazuje, że jest to możliwe i przynosi ogromne korzyści – sterowanie z częstotliwością 100 kHz nie byłoby osiągalne, gdyby trzeba było wysyłać dane do zewnętrznego serwera. Również Knaak et al. (2022) zaproponowali architekturę głębokiego uczenia do detekcji wad spawania zoptymalizowaną właśnie pod platformy wbudowane o niskiej mocy, używając lekkich CNN i sieci rekurencyjnej do analizy sekwencji obrazów – ich model działał na niedrogim komputerze jednopłytkowym (porównywalnym z Raspberry Pi) w czasie rzeczywistym. Trendem jest projektowanie mniejszych, bardziej efektywnych modeli (np. wykorzystanie sieci pruned, quantized), które zachowują wysoką skuteczność, a są możliwe do uruchomienia na sprzęcie przemysłowym w linii (często pracującym w ciężkich warunkach, gdzie chłodzenie potężnych GPU byłoby trudne). Dzięki Edge AI fabryki mogą korzystać z AI bez uzależnienia od połączeń internetowych i chmur – co bywa istotne z powodów bezpieczeństwa i poufności.

Cyfrowe bliźniaki i symulacje sprzężone z AI: Cyfrowy bliźniak to wirtualna replika procesu fizycznego, tworzona na podstawie modeli symulacyjnych i zasilana danymi z czujników w czasie rzeczywistym. Integracja AI z cyfrowymi bliźniakami jest postrzegana jako kolejny etap rozwoju produkcji z wykorzystaniem laserów. W kontekście obróbki laserowej cyfrowy bliźniak może zawierać modele zjawisk fizycznych (np. model termiczny i fluidalny jeziorka spawalniczego, model optyczny propagacji wiązki) połączone z modułami AI do predykcji i sterowania. Taki system pozwala przewidywać skutki zmian parametrów w wirtualnym środowisku zanim zostaną wprowadzone na realnej maszynie. Przykładowo, przed zwiększeniem mocy laserowej, cyfrowy bliźniak może zasymulować, czy nie spowoduje to podtopienia materiału – jeśli symulacja (wspomagana AI) pokaże ryzyko wady, to realny system może dostosować decyzję. Cyfrowe bliźniaki umożliwiają także proaktywne sterowanie jakością – zamiast reagować dopiero gdy czujnik wykryje wadę, model predykcyjny w bliźniaku może wcześniej wykryć trend w kierunku powstania wady i zawczasu skorygować parametry. Badania pokazują, że połączenie czujników, modeli fizycznych i AI w ramach bliźniaka pozwala znacząco zredukować liczbę defektów. Na przykład, w procesie napawania laserowego (laser cladding) zastosowanie bliźniaka sprzężonego z algorytmami ML umożliwiło wczesne wykrywanie i korygowanie odchyleń grubości nakładanej warstwy, co przesunęło kontrolę jakości z reaktywnej na proaktywną. Inne studium wykazało, że wykorzystując bliźniaka połączonego z siecią neuronową można w czasie rzeczywistym regulować parametry w procesie selektywnego topienia proszku laserem (LPBF) tak, by uniknąć wad typu lack of fusion – bliźniak symuluje powstawanie wad i kieruje AI do korygowania ścieżki lasera lub energii. W perspektywie najbliższych lat spodziewany jest rozwój hybrydowych modeli fizyczno-uczących się (np. physic-informed AI), które łączą znajomość równań fizycznych z elastycznością ML, co przyspieszy symulacje i poprawi ich zgodność z rzeczywistością. Cyfrowe bliźniaki z AI staną się zapewne standardowym narzędziem przy opracowywaniu nowych procesów laserowych – będą pozwalały testować „co-jeśli” (np. wpływ zmiany geometrii detalu na jakość spoin) bez ryzyka zatrzymania produkcji czy marnowania materiału.

Podsumowując, zastosowanie AI w obróbce laserowej już teraz przynosi znaczące korzyści, ale pełne jego wykorzystanie wymaga pokonania opisanych wyżej wyzwań. Kluczowe kierunki rozwoju to zwiększanie niezawodności i transparentności systemów AI (poprzez XAI i rygorystyczne testy), zapewnienie ich działania w wymagających warunkach przemysłowych (Edge AI, odporność na zakłócenia), a także głębsza integracja z cyfrową infrastrukturą fabryki (bliźniaki cyfrowe, IoT). Dzięki temu przyszłe linie produkcyjne z laserami będą jeszcze bardziej inteligentne, samouczące się i autonomiczne, co przełoży się na lepszą jakość wyrobów, mniejsze straty oraz większą elastyczność produkcji.

Podsumowanie

Zastosowanie sztucznej inteligencji w przemyśle laserowym intensywnie się rozwija, obejmując zarówno inteligentną kontrolę jakości wizyjnej, jak i autonomiczne dostrajanie parametrów procesów takich jak spawanie, cięcie czy teksturowanie laserowe. Techniki uczenia maszynowego i głębokiego pozwalają wykrywać defekty spoin i powierzchni w czasie rzeczywistym z dokładnością przewyższającą metody konwencjonalne, co podnosi niezawodność i wydajność produkcji. Systemy wizyjne z kamerami i algorytmami CNN/Transformer, zintegrowane z robotami i maszynami CNC, potrafią nie tylko wychwycić wadę, ale i na bieżąco korygować trajektorię czy parametry procesu, zamykając pętlę sterowania. Z kolei algorytmy uczenia ze wzmocnieniem, genetyczne i neuro-rozmyte otwierają drogę do laserowych systemów, które uczą się optymalnych ustawień dla zmiennych warunków pracy, przewyższając osiągi statycznie zaprogramowanych maszyn. Studium przypadków – od spawania karoserii samochodowych, przez precyzyjne cięcie elementów, po teksturowanie funkcjonalnych powierzchni – dowodzą, że AI realnie przekłada się na lepszą jakość (mniej wad, lepsze parametry wytrzymałościowe), wyższą produktywność (krótsze czasy cyklu, mniej poprawek) oraz redukcję kosztów (mniej złomu, optymalne zużycie energii).

Aby jednak w pełni wykorzystać potencjał AI, należy sprostać pewnym wyzwaniom. Konieczne jest zapewnienie, że modele są odporne na różnorodność warunków i dostępne są odpowiednie dane do ich trenowania. Istotne jest budowanie zaufania do AI poprzez mechanizmy wyjaśnialności oraz projektowanie systemów bezpiecznych i przewidywalnych w działaniu. Rozwijające się technologie jak Edge AI (przetwarzanie na brzegu) i cyfrowe bliźniaki będą odgrywać coraz większą rolę w implementacji AI na liniach produkcyjnych, umożliwiając proaktywne sterowanie procesem i ciągłe doskonalenie poprzez symulacje i uczenie się.

Reasumując, AI staje się integralną częścią nowoczesnych systemów laserowych, przekształcając je w inteligentne, samoadaptujące się urządzenia. Trend ten wpisuje się w szerszą koncepcję Przemysłu 4.0, gdzie procesy produkcyjne są monitorowane i optymalizowane w sposób cyfrowy i autonomiczny. Można oczekiwać, że w najbliższych latach rozwiązania oparte na AI – zwłaszcza te zapewniające wyjaśnialność i bezpieczeństwo – będą coraz powszechniejsze w aplikacjach laserowych, przyczyniając się do dalszego zwiększania jakości produktów przemysłowych i elastyczności wytwarzania. Jak wykazano, już dziś AI potrafi podnieść skuteczność kontroli jakości i sterowania procesem do poziomu nieosiągalnego tradycyjnymi metodami, a przyszłe badania i rozwój będą tę przewagę tylko powiększać. Można zatem stwierdzić, że sztuczna inteligencja w obróbce laserowej nie jest już futurystyczną wizją, lecz realnym czynnikiem rewolucjonizującym przemysł w kierunku bardziej inteligentnej, bezpiecznej i wydajnej produkcji.